「生成AIを業務に導入したいけれど、情報漏洩や著作権侵害などのリスクが怖くて、なかなか一歩を踏み出せない…」─そんな悩みを抱え、足踏みしている企業担当者は多いのではないでしょうか。

「競合他社はどんどん活用しているのに」と焦る一方で、明確なルールもないまま現場に丸投げしてしまえば、取り返しのつかないインシデントに発展する危険性があります。セキュリティ部門、法務部門、そして実際に使う現場─それぞれの懸念や希望が交錯し、ガイドライン作りだけで疲弊してしまうケースも珍しくありません。

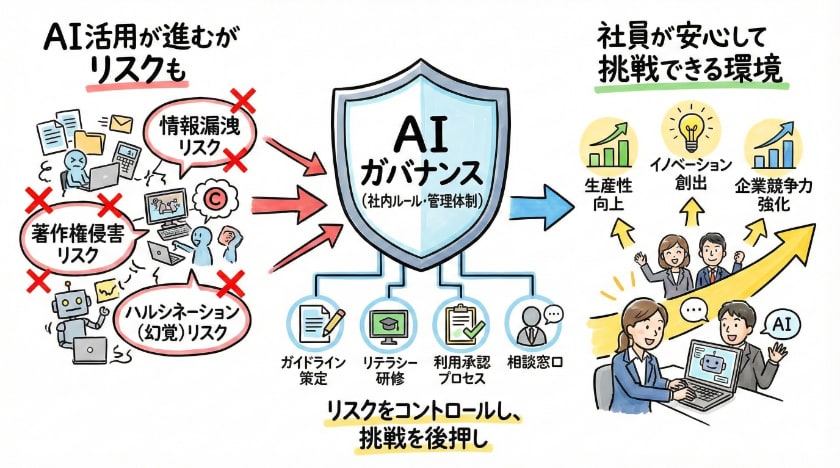

実際、企業が生成AIの活用において最もつまずきやすいのが、「安全に運用するためのルールと体制(AIガバナンス)が整っていない」ことなのです。

いくら画期的なAIツールを導入しても、リスク管理や運用ルールが曖昧なままでは、企業の信頼を根底から揺るがす事態になりかねません。しかし逆に言えば、適切なAIガバナンスを構築してしまえば、現場は安心してAIを使いこなし、その潜在的な価値を最大限に引き出すことができるのです。

この記事では、生成AIを安全かつ効果的に活用するために不可欠な「AIガバナンス」の基本から、具体的な導入ステップ、そして企業が目指すべき姿まで、担当者が今すぐ知っておくべき情報を詳しくお伝えします。

簡単に説明する動画を作成しました!

目次

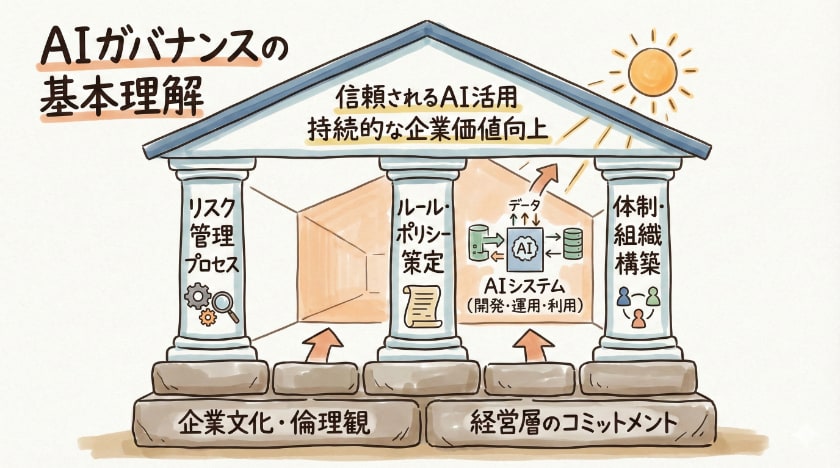

AIガバナンスの基本理解

AIガバナンスとは何か

AIガバナンスとは企業がAI技術を適切に利用しそのリスクを管理するための体制やルールやプロセスを整備し運用することです。

AI活用における倫理的な側面や法規制遵守やセキュリティ確保やプライバシー保護など多岐にわたる領域を対象とします。

AIガバナンスの目的はAI技術の安全性や透明性や公平性を確保し人間中心のAI利活用を実現することです。

私が超DX仕事術でお伝えしている通りデジタル技術を導入しただけで満足していては何も変わらないので継続的な改善を繰り返していくことが求められます。

AIガバナンス体制の構築はAI開発者だけでなく経営層を含む企業全体で取り組むべき課題です。

AIに関するリスク管理を適切に行うためにAIガバナンスは不可欠な要素となります。

生成AIの重要性

生成AIは文章や画像や音楽などさまざまなコンテンツを自動生成するAI技術です。

ビジネスにおける生成AIの重要性はその競争力を高める可能性にあります。

生成AIを活用することで業務効率化や新たなサービス創出や顧客体験の向上などが期待できます。

以前私の知り合いにダイエットアプリの導入でIT化とDX化の違いを説明したようにツールを導入するだけでなくそれを活用して改善まで行うことが本来の目的です。

一方不適切な情報や偏った出力が生成されるリスクや著作権侵害などの課題も存在します。

企業は生成AIの導入にあたりこれらのリスクを理解し適切な対策を講じる必要がありAI利活用に関するガイドラインの策定や従業員向けの教育が重要となります。

企業における必要性

企業におけるAIガバナンスの必要性はAI技術の導入がビジネスに与える影響の大きさに起因します。

AIシステムが企業の事業運営に深く組み込まれるにつれてリスク管理の重要性が増します。

会社員時代のシステム更改時に経験したように現場の業務がわからない部門に任せっきりの受け身体制では業務に使えないシステムが出来上がってしまいます。

AIガバナンスの整備は法令遵守だけでなく企業倫理の観点からも求められます。

AIの利用状況を監査し評価する仕組みを構築することで透明性を確保しステークホルダーからの信頼を得ることができます。

AIガバナンスを通じて企業はAI技術を安全かつ効果的に活用し持続可能な成長を実現することが可能になります。

そのためにも企業はAIガバナンスに関する取り組みを推進する必要があります。

生成AI導入のプロセス

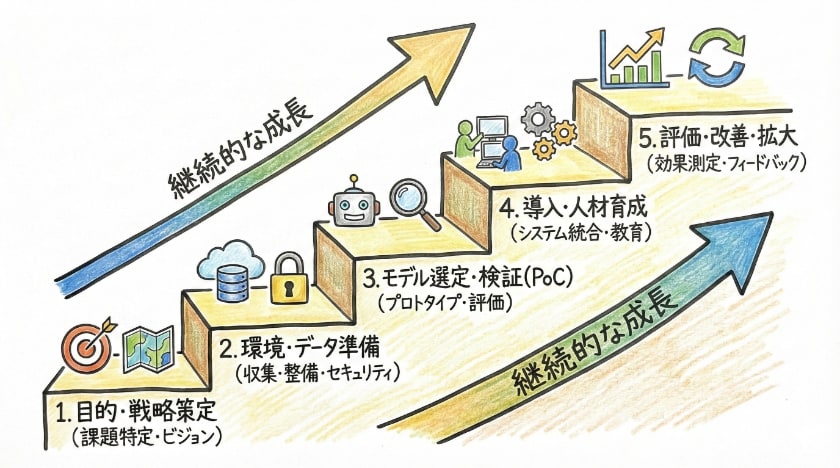

導入のためのステップ

生成AIの企業への導入は、組織のデジタルトランスフォーメーションを推進する重要なステップです。

このプロセスでは、まず自社のビジネスにおける生成AIの利用目的を明確化することが必要です。

次に、AI活用に必要なデータを収集整備し、適切なAIモデルを選定します。

超DX仕事術でもお伝えしている通り、目的に応じて必要なデータをできるだけ集め、それを活用していけば精度の高い戦略を立てることができるのです。

生成AIの導入においては、倫理的な側面や法規制遵守も考慮する必要があります。

具体的には、AIによる出力結果のバイアスやプライバシー侵害のリスクを評価し、適切な対策を講じることが求められます。

企業全体でAIに関する理解を深め、AIガバナンスの基本を共有することも、導入を成功させるための不可欠な要素です。

導入後も、AIシステムのパフォーマンスを継続的に評価し、改善を行うことが重要です。

必要な体制の構築

生成AIの導入を成功させるためには、適切な体制の構築が不可欠です。

AIガバナンスを整備し、AIの倫理的な利用を監督するAIに関する専門チームを設置することが望ましいです。

このチームは、AI開発者だけでなく、法務、コンプライアンス、セキュリティなどの関連部署の担当者を含むべきです。

私自身、会社員時代にシステム更改を行った際、業務部門との壁を取り払うのに一苦労した経験があります。

だからこそ、一部の部門に丸投げするのではなく、多様な視点を持つチームで取り組むことが大切なのです。

AI活用に関するガイドラインを策定し、企業全体で共有することで、AI利用におけるリスクを低減できます。

また、従業員向けのAI教育プログラムを実施し、AI技術の基本や倫理、法規制に関する理解を深めることも重要です。

さらに、AIシステムの利用状況を定期的に監査し、評価することで、AIガバナンス体制の効果を検証し、改善につなげることができます。

リスク管理の方針を明確にすることも重要です。

リスク管理の方針

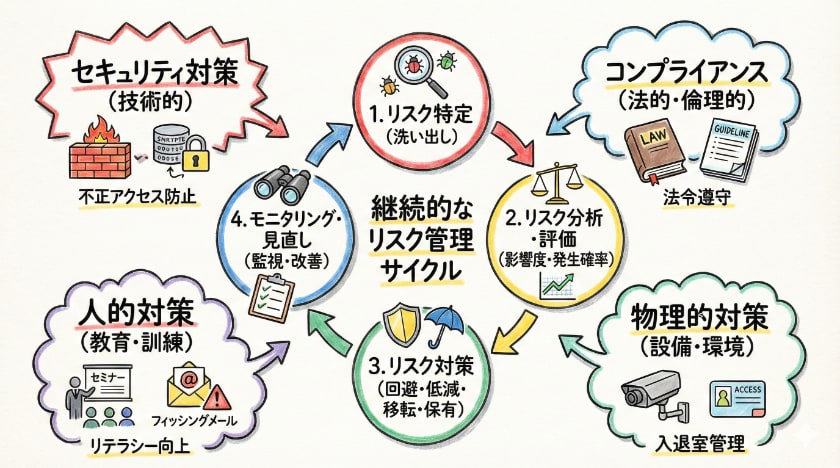

生成AIの導入におけるリスク管理は、企業が安全かつ責任あるAI利用を実現するために不可欠です。

リスク管理の方針では、AIによる不適切な情報生成、プライバシー侵害、セキュリティ脆弱性などのリスクを特定し、それらに対する具体的な対策を定める必要があります。

例えば、AIモデルの出力結果を検証するプロセスを導入したり、個人情報保護に関する法規制遵守を徹底したりすることが考えられます。

また、AIシステムへの不正アクセスを防ぐためのセキュリティ対策を強化することも重要です。

どんなに優れたITツールでも、常にセキュリティリスクがあることを念頭に置きながら使用すべきです。

セキュリティ事故の7割は人的要因とも言われていますから、ツールの機能と個人のリテラシーの両面から対策することが求められます。

リスクが発生した場合の対応策を事前に策定し、迅速かつ適切に対応できる体制を整備することも求められます。

AIガバナンス体制を整備し、リスク管理を徹底することで、企業は生成AIの潜在的な価値を最大限に引き出すことができます。

リスク管理と対策

AI活用におけるリスク

AI活用、特に生成AIの導入は、企業に大きな価値をもたらす可能性がある一方で、さまざまなリスクも伴います。

例えば、不正確な情報や偏った出力が生成AIによるものだった場合、企業の評判を損なう可能性があります。

また、AIが個人データを不適切に処理することで、プライバシー侵害のリスクも生じます。

さらに、AIシステムのセキュリティ脆弱性を悪用したサイバー攻撃のリスクも考慮する必要があります。

超DX仕事術でもお伝えしていますが、どんなに優れたITツールでも常にセキュリティリスクがあることを念頭に置きながら使用すべきです 。

これらのリスクを適切に管理するためには、AIに関する深い理解と、綿密なリスク管理の体制構築が不可欠です。

特にデータの取り扱いには注意が必要です。

セキュリティ事故の7割は人的要因という統計結果も出ていますから、悪意がなくても発生し得るリスクに備える必要があります 。

実現に向けた対策

生成AIの導入におけるリスクを軽減し、その価値を最大限に引き出すためには、具体的な対策を講じる必要があります。

まず、AIの倫理的な利用に関する明確なガイドラインを策定し、従業員全体で共有することが重要です。

また、AIの出力結果を検証するプロセスを導入し、不適切な情報が拡散されるのを防ぐ必要があります。

さらに、個人情報保護に関する法令を遵守するための体制を整備し、プライバシー侵害のリスクを最小限に抑えることが求められます。

また、AIシステムのセキュリティ対策を強化し、不正アクセスやデータ漏洩を防ぐことも不可欠です。

こうした人的ミスや事故を防ぐには、システムの機能を使って自動的に回避したり、個人のセキュリティリテラシーを上げたりすることが重要となります 。

AIに関する教育を徹底することで、リスクを減らすことができます。

法規制の状況と対応

AI技術の急速な進化に伴い、AIに関する法規制の整備も進んでいます。

企業は、AIの利用にあたり、これらの法規制を遵守する必要があります。

例えば、個人情報保護法や著作権法など、既存の法令に加え、AI固有のリスクに対応するための新たな法規制が導入される可能性もあります。

これらの法規制の状況を常に把握し、適切に対応することが、企業のコンプライアンス体制を維持するために不可欠です。

会社側が把握していない「シャドーIT」や、使われなくなった「野良ツール」からデータが流出してしまう恐れもあるため、利用状況の管理を徹底しましょう 。

また、AIの倫理的な利用に関する自主的なガイドラインを策定し、法令遵守だけでなく、企業倫理の観点からも適切なAI活用を推進することが重要です。

リスクに対しては、回避、軽減、移転、保有といった4つの対策から適切なものを選択し、あらかじめ備えておくことが肝心です 。

これらはAIガバナンスの重要な取り組みの一つです。

AIガバナンスの運用と支援

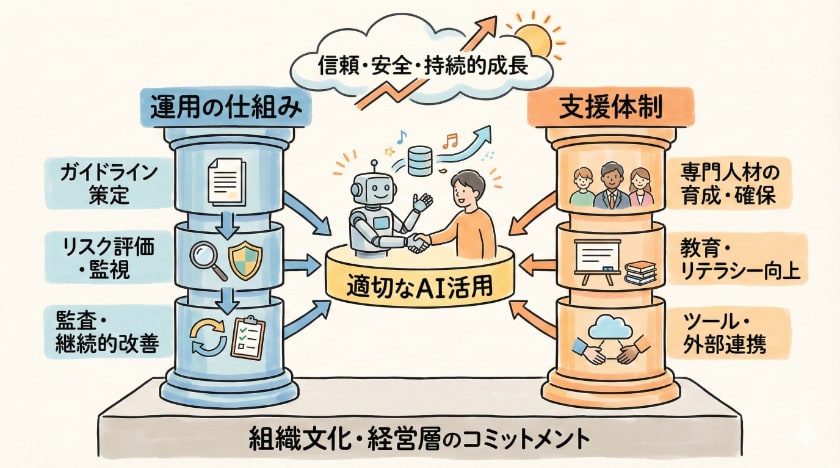

運用のための仕組み

AIガバナンスの運用において、企業がAI技術を適切に利用するための仕組み構築は不可欠です。

この仕組みは、AIの開発から導入、運用、そして評価までのプロセス全体を対象とします。

具体的には、AIの倫理的な利用に関するガイドラインの策定、リスク管理の体制の整備、AIシステムのセキュリティ確保、プライバシー保護のための対策などが含まれます。

超DX仕事術でもお伝えしていますが、仕組み化ができればその業務の属人化から脱却できます。

ルーチン化できることはシステムに任せ、人間が判断すべきことに注力することが大切です。

また、AIの利用状況を定期的に監査し、その結果を評価することで、AIガバナンスの効果を検証し、改善につなげることができます。

これらの取り組みを通じて、企業はAI技術を安全かつ効果的に活用し、持続可能なビジネス成長を実現することが可能です。

関連する人材の確保

AIガバナンスの運用を支援するためには、関連する人材の確保が不可欠です。

これには、AI開発者、データサイエンティスト、倫理の専門家、法規制に詳しい人材、セキュリティエンジニアなどが含まれます。

これらの人材は、AI技術の開発から運用、そしてリスク管理まで、AIガバナンスの全領域において重要な役割を果たします。

とはいえ、社内だけですべての人材を揃えるのは難しい場合もあるでしょう。

私自身も、全部自分でやろうとせず、苦手なことは人に振ることを推奨しています。

外部の専門家やコンサルタントの支援を利用することも有効です。

また、AIに関する教育プログラムを提供し、従業員全体のAIに関する理解を深めることも重要です。

事例紹介と学び

様々な企業におけるAIガバナンスの導入事例を紹介することは、他の企業がAIガバナンスを構築する上での貴重な学びとなります。

成功事例からは、AI技術を安全かつ効果的に利用するためのベストプラクティスを学ぶことができます。

一方、失敗事例からは、AI導入におけるリスクや課題を理解し、同様の過ちを避けるための教訓を得ることができます。

失敗はテストの一環と考え、小さく始めて小さな成功体験を積み重ねることが大事なのです。

私のように普通の人は、ほかの人のよいところを真似して、自分に当てはめることが一番の近道です。

これらの事例紹介を通じて、企業は自社のビジネスに最適なAIガバナンスの体制を構築するためのヒントを得ることができます。

また、AIの倫理的な利用や法規制遵守に関する取り組みも、事例を通じて具体的に理解することができます。

AIガバナンスの課題と未来

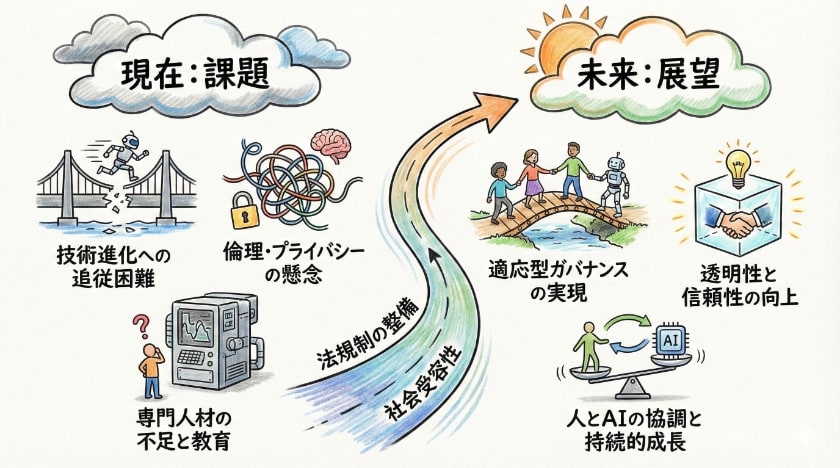

現在の課題

AIガバナンスの現在の課題として、AI技術の急速な進化に対応しきれていない点が挙げられます。

AI技術は日々進化しており、それに応じてAIガバナンスのルールやプロセスも改善していく必要があります。

私が超DX仕事術でもお伝えしていますが、VUCAと呼ばれる予測困難な時代では、環境の変化に応じて素早く判断しつづける必要があります。

AIガバナンスも一度決めて終わりではなく、OODAループのように常に改善を繰り返していく姿勢が大切です。

また、AIの利用における倫理的な問題やプライバシー保護に関する課題も依然として存在します。

これらの課題に対応するためには、企業はAIに関する倫理的なガイドラインを策定し、従業員全体で共有することが重要です。

さらに、AIの利用状況を定期的に監査し、その結果を評価することで、AIガバナンスの効果を検証し、改善につなげることが求められます。

今後の取り組みと方向性

今後のAIガバナンスにおける取り組みと方向性として、AI技術の進化に対応した柔軟な体制の構築が挙げられます。

これには、AIの倫理的な利用に関するガイドラインの継続的な改善や、リスク管理のプロセスの見直しが含まれます。

また、AIの透明性を確保するための取り組みも重要です。

具体的には、AIの出力結果の根拠を説明したり、AIの判断プロセスを可視化したりすることが考えられます。

判断プロセスを可視化し客観的なデータに基づいて検証することは、勘や経験や感情の3Kに頼らない意思決定にもつながります。

さらに、AIに関する法規制の状況を常に把握し、適切に対応することも企業のコンプライアンス体制を維持するために不可欠です。

今後はAIガバナンスがより重要視される可能性があります。

AI技術の進化とその影響

AI技術の進化は、ビジネスや社会全体に大きな影響を与えています。

AI技術の進化により、これまで人間が行っていた業務が自動化され、業務効率が向上する一方で、新たなリスクも生まれています。

私が超DX仕事術でお伝えしてきた守りのDX仕事術で生産性を向上させつつ、こうした新たなリスクにしっかりと対処していくことが求められます。

例えば、AIによるデータ分析の結果が偏っていた場合、差別的な結果が生じる可能性があります。

また、AIが個人情報を不適切に処理することで、プライバシー侵害のリスクも生じます。

これらのリスクに対応するためには、企業はAIの倫理的な利用に関するガイドラインを策定し、従業員全体で共有することが重要です。

さらに、AIの利用状況を定期的に監査し、その結果を評価することで、AIガバナンスの効果を検証し、改善につなげることが求められます。

AIガバナンス解説:企業に必要な生成AI導入と求められる姿に関する「よくある質問」

Q1: AIガバナンスとはそもそも何ですか?

AIガバナンスとは、企業が生成AIを安全かつ効果的に活用するための「社内ルールや管理体制」のことです。

車を安全に運転するために交通ルールや信号機が必要なように、AIという強力なツールを使いこなすためにも適切なルールが必要です。

単にAIの利用を禁止・制限するのではなく、リスクをコントロールしながら、ビジネスの成長や業務効率化を後押しするための仕組みだとお考えください。

Q2: なぜ今、企業に生成AIの導入とAIガバナンスが必要とされているのですか?

ChatGPTなどの生成AIは非常に便利で、業務の生産性を劇的に向上させるポテンシャルを持っています。

しかし、個人の判断で勝手に業務利用してしまうと、顧客データや社外秘の情報を誤ってAIに入力してしまう「情報漏洩」のリスクが高まります。

企業として競争力を維持するために生成AIの導入は不可避ですが、それと同時に企業ブランドや信用を守るためのガバナンスが車の両輪として必須になっているのです。

Q3: 生成AIを利用する際、具体的にどのようなリスクに注意すべきですか?

特に注意すべきリスクは大きく3つあります。

1つ目は前述した「機密情報や個人情報の漏洩」です。2つ目は、AIが生成した文章や画像が他人の権利を侵してしまう「著作権侵害」のリスク。そして3つ目が、AIがもっともらしい嘘をつく「ハルシネーション(幻覚)」です。

これらのリスクを社員全員が理解し、AIの出力結果を人間が必ず最終確認(ファクトチェック)するプロセスを設けることが重要です。

Q4: AI活用において、企業に「求められる姿」とはどのようなものですか?

企業に求められるのは、「社員が安心してAIに挑戦できる環境づくり」です。

ガバナンスと聞くとガチガチの監視をイメージしがちですが、本来の目的は社員を守ることです。

明確なガイドラインを提示し、万が一トラブルが起きそうな時に相談できる窓口を設けることで、現場の社員が萎縮することなく、自発的にAIを使って業務改善やイノベーションを生み出せる組織こそが、これからの時代に求められる企業の姿です。

Q5: AIガバナンスを構築するには、まず何から始めればよいですか?

まずは小さく始めることが成功の秘訣です。最初の一歩として、「生成AI利用ガイドライン」を策定し、全社に周知することから始めてください。

ガイドラインには「入力してはいけない情報」と「利用しても良い業務範囲」をシンプルに明記します。

同時に、社員向けのAIリテラシー研修を実施し、正しい使い方とリスクの基礎知識を学んでもらうことが、最も効果的で確実なスタートダッシュとなります。

DXやITの課題解決をサポートします! 以下の無料相談フォームから、疑問や課題をお聞かせください。40万点以上のITツールから、貴社にピッタリの解決策を見つけ出します。

このブログが少しでも御社の改善につながれば幸いです。

もしお役に立ちそうでしたら下のボタンをクリックしていただけると、 とても嬉しく今後の活力源となります。 今後とも応援よろしくお願いいたします!

IT・通信業ランキング | にほんブログ村 |

もしよろしければ、メルマガ登録していただければ幸いです。

【メルマガ登録特典】DX戦略で10年以上勝ち続ける実践バイブル『デジタル競争勝者の法則』をプレゼント!

今すぐプレゼントを受け取る

今すぐプレゼントを受け取る