ニュースで断片的に報じられるドローン攻撃や自律型兵器システム。「どこか遠い国の話だろう」と、他人事に感じている方も多いかもしれません。しかし水面下では、情報収集から戦略立案、さらには直接的な兵器開発に至るまで、AIの軍事利用は私たちの想像をはるかに超えるスピードで拡大し、各国が開発にしのぎを削っています。

現代の戦争のあり方を根本から覆すこの技術において、最大の懸念は「AIの進化に、倫理や国際的なルールが全く追いついていない」ことです。

人間の判断を介さずにAIが標的を決定し、攻撃を実行する──。これが当たり前になれば、戦争の歯止めが利かなくなり、取り返しのつかない事態を招きかねません。しかし一方で、国家の安全保障を考えたとき、AIの圧倒的な処理能力や効率性を「使わない」という選択肢がすでに失われつつあるのも事実です。

米国と中国による激しい覇権争い、そこに深く関与する巨大テクノロジー企業の思惑。AIがもたらす戦術的なメリットと、人類を脅かす潜在的なリスクとは一体何なのでしょうか。

この記事では、国際社会でかつてない議論を呼んでいるAI軍事利用の「今」を詳細に分析し、これからの世界が直面する真の危険性について分かりやすく解き明かします。

簡単に説明する動画を作成しました!

目次

AIの軍事利用の現状

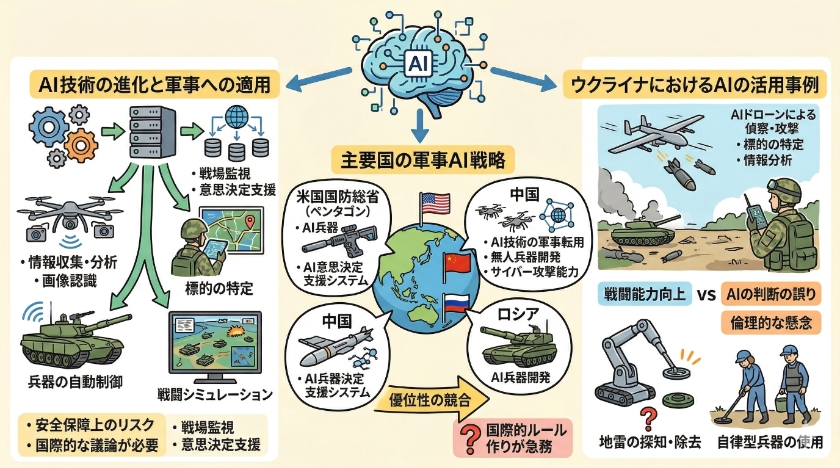

AI技術の進化と軍事への適用

AI技術、特に生成AIの進化は目覚ましく、軍事分野への適用が加速しています。

AIの軍事利用は、情報収集・分析、標的の特定、兵器の自動制御、戦闘シミュレーションなど、多岐にわたる分野で進んでいます。

例えば、AIを活用した画像認識システムは、戦場での監視活動を支援し、敵の動きを迅速に察知することを可能にします。

これはビジネスにおける超DX仕事術でお伝えしている、V3Sの法則である可視化や細分化のプロセスを自動化していることと同じですね。

また、AIは膨大なデータを解析し、戦略的な意思決定を支援することで、軍事作戦の効率化に貢献します。

私が常々お伝えしている、勘や経験や感情の3Kに頼らないデータ流用と活用が、戦場という極限の状況でも求められているわけです。

しかし、AI技術の急速な発展は、安全保障上の新たなリスクも生み出しており、国際的な議論が必要です。

主要国の軍事AI戦略

米国、中国、ロシアをはじめとする主要国は、AIの軍事利用を国家戦略の重要な柱と位置づけ、研究開発に巨額の投資を行っています。

米国国防総省(ペンタゴン)は、AIを活用した兵器システムの開発や、AIによる意思決定支援システムの構築を推進しています。

中国もまた、AI技術の軍事転用を積極的に進めており、無人兵器の開発やサイバー攻撃能力の強化に力を入れています。

ロシアもAI兵器の開発を進めており、AIが今後の軍事バランスに与える影響は計り知れません。

私がITコンサルティングで企業のDX推進を支援する際も、こうしたシステム化の優位性は明確に表れますが、国家規模になるとその影響は甚大です。

各国はAIの軍事利用において、優位性を確立しようと競い合っています。

この現状は、AIの軍事利用に関する国際的なルール作りを急務としています。

ウクライナにおけるAIの活用事例

ウクライナ戦争は、AI技術が戦場で実際に活用される事例を示すものとなっています。

ウクライナ軍は、AIを活用したドローンによる偵察や攻撃、標的の特定、情報分析などを行っています。

また、AIは、兵士の安全を確保するために、地雷の探知や除去にも活用されています。

これは危険な定型作業をシステムやロボットに任せるRPAの考え方とも通じる部分があります。

AIの軍事利用は、ウクライナ軍の戦闘能力向上に貢献していますが、同時に、AIによる判断の誤りや、自律型兵器の使用に関する倫理的な懸念も浮上しています。

超DX仕事術で述べているように、システムに任せられる部分は任せつつも、最終的な判断は人間がやらなければならない領域です。

ウクライナでのAIの活用事例は、AIの軍事利用のメリットとデメリット、そして潜在的な危険性について、より深く考察するための重要な材料を提供しています。

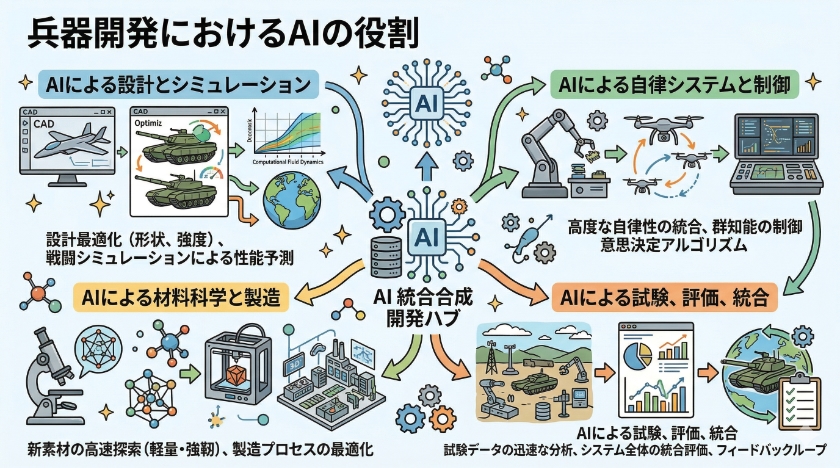

兵器開発におけるAIの役割

自律型兵器システムの可能性

AI技術の軍事利用が拡大する中で、特に注目されているのが自律型兵器システムの開発です。

AIが搭載された兵器は、人間の指示なしに自律的に標的を特定し、攻撃を行う可能性を秘めています。

このようなシステムは、戦場での意思決定速度を飛躍的に向上させ、人間の介入なしに戦闘を遂行できるため、軍事的な優位性を確立する上で必要不可欠と国も出てきています。

これは、私が提唱する超DX仕事術における、究極の自動化(レベル3)に通じるものがあります。システムに任せられる部分はすべて任せ、人間は意思決定に集中するという考え方ですね。

しかし、AIによる判断の誤りや、予期せぬ事態への対応能力の欠如は、戦争の制御不能なエスカレーションを招く危険性も孕んでいます。

また、倫理的な懸念も大きく、人間が責任を負うことができない状況を生み出す可能性があります。

自律型兵器の利用は、軍事戦略における革新であると同時に、深刻な倫理的、安全保障上の課題を提起しています。

ビジネスにおいても、自動化ツールやAIに完全に依存してしまうと、思わぬミスやトラブルに気づけないリスクがありますが、命に関わる軍事分野ではそのリスクが桁違いになります。

AIによる戦闘シミュレーション

AIは、兵器開発において、戦闘シミュレーションの分野でも重要な役割を果たしています。

AIを活用することで、現実の戦場を模倣した複雑なシミュレーションを高速かつ大規模に実行することが可能になります。

これにより、新たな兵器システムの性能評価や、軍事戦略の有効性を検証することができます。

また、AIは、過去の戦争のデータを分析し、未来の戦争の可能性を予測することもできます。

超DX仕事術でお伝えしている「データ活用」の極致と言えます。蓄積された膨大なデータを分析し、未来の戦略を立てることは、ビジネスでも軍事でも全く同じアプローチなのです。

このような情報は、国防戦略の策定や、兵器開発の方向性を決定する上で極めて重要です。

しかし、シミュレーションの精度や、AIの判断の信頼性については、常に検証が必要です。

過度にシミュレーションの結果に依存することは、現実の戦場での誤った判断を招く危険性もあります。

私が企業のDXを支援する際も、データやツールはあくまで手段であり、最終的な判断材料にすぎないとお伝えしています。3K(勘・経験・感情)に頼らないことは重要ですが、システムの盲信もまた禁物ということですね。

兵器開発における企業の影響

AI技術の軍事転用において、企業の役割はますます大きくなっています。

特に、米国や中国などの国では、AI技術に強みを持つ企業が、国防省や軍と連携し、兵器システムの開発を加速させています。

これらの企業は、AIを活用した標的識別システム、自律型ドローン、サイバー攻撃防御システムなど、多岐にわたる軍事技術を開発しています。

しかし、企業の軍事研究への関与は、倫理的な懸念も生み出しています。

利益追求を優先する企業が、安全保障上のリスクや倫理的な問題を軽視する可能性も否定できません。

また、企業が開発したAI技術が、国際的な法規制の対象外となる場合もあり、軍事的な利用の透明性や責任の所在が曖昧になるという問題も存在します。

企業DXを進める上でも、「シャドーIT」や「野良ツール」によるセキュリティリスクや責任の所在が曖昧になる問題をお話ししていますが、兵器開発の現場でも同様の、より深刻な管理・統制の課題が存在しているのでしょう。

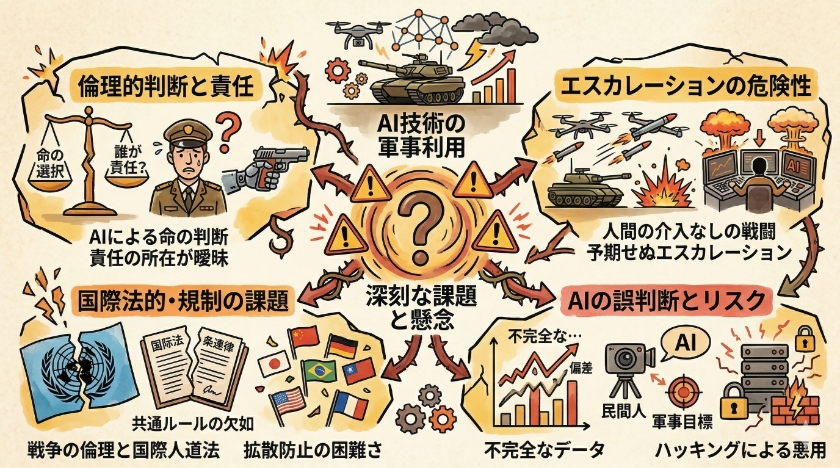

AIの軍事利用に関する懸念

倫理的な判断とリスク

AIの軍事利用は、倫理的な判断を複雑にし、新たなリスクを生み出します。

自律型兵器システムが人間の判断なしに標的を特定し、攻撃を決定する可能性は、戦争犯罪の責任の所在を曖昧にします。

私が超DX仕事術でお伝えしているように、システム化や自動化は非常に便利ですが、最終的な責任は常に人間が負うべきものです。

これはビジネスでも軍事でも変わりません。

AIが倫理的なジレンマに直面した場合、適切な判断を下せるのかという懸念もあります。

また、AIシステムの誤作動やハッキングによる悪用も、大きなリスクです。

企業のDX推進においても、シャドーITや野良ツールによるセキュリティリスクについて触れましたが、命に関わるシステムが乗っ取られる恐怖は想像を絶しますよね。

例えば、誤った情報に基づいて攻撃が実行されたり、敵対勢力にAIシステムを乗っ取られたりする可能性も考えられます。

これらのリスクを軽減するためには、AIの軍事利用に関する厳格な倫理的ガイドラインと、安全性を確保するための技術的な対策が必要です。

国際的な法律と規制の課題

AIの軍事利用が拡大するにつれて、国際的な法律と規制の整備が急務となっています。

現在、自律型兵器システムの使用を禁止する国際的な合意は存在せず、各国が独自の基準で開発と利用を進めている状況です。

このため、AI兵器の利用に関する共通のルールを確立し、戦争の倫理と国際人道法を遵守するための枠組みを構築する必要があります。

会社組織でいえば、新しいITツールを導入する際に、全社的な運用ルールやセキュリティポリシーを策定するプロセスとよく似ています。

規模が国家間になると、その調整は途方もない労力が必要になるでしょう。

また、AI技術の軍事転用を規制し、AI兵器の拡散を防止するための国際的な協力も不可欠です。

国連をはじめとする国際機関が中心となり、議論を加速させ、実効性のある規制を提供していくことが求められます。

AIの誤判断による危険性

AIは、高度な判断能力を持つ一方で、誤った判断をする危険性も孕んでいます。

AIシステムは、データに基づいて学習しますが、そのデータに偏りがあったり、不完全であったりすると、誤った判断を下す可能性があります。

これはまさに、超DX仕事術でお伝えしているデータの重要性そのものです。

質の低いデータからは質の低い結果しか生まれませんし、V3Sのフレームワークで現状をしっかり可視化や特定できていないままシステム化を急ぐと、大きな事故につながります。

例えば、戦場での標的識別において、AIが民間人を軍事的な標的と誤認する可能性や、誤った情報に基づいて攻撃を開始する可能性も考えられます。

また、AIシステムは、人間の判断を介さずに自律的に行動するため、誤った判断が戦争のエスカレーションを招く危険性もあります。

これらの危険性を軽減するためには、AIシステムの判断プロセスを透明化し、人間が常にAIの行動を監視し、必要に応じて介入できる仕組みを構築する必要があります。

どんなに優れたRPAやAIツールを導入したとしても、完全にシステム任せにするのは危険であり、人間が介入できる余白や監視体制を残しておくことがリスク管理の基本となるのです。

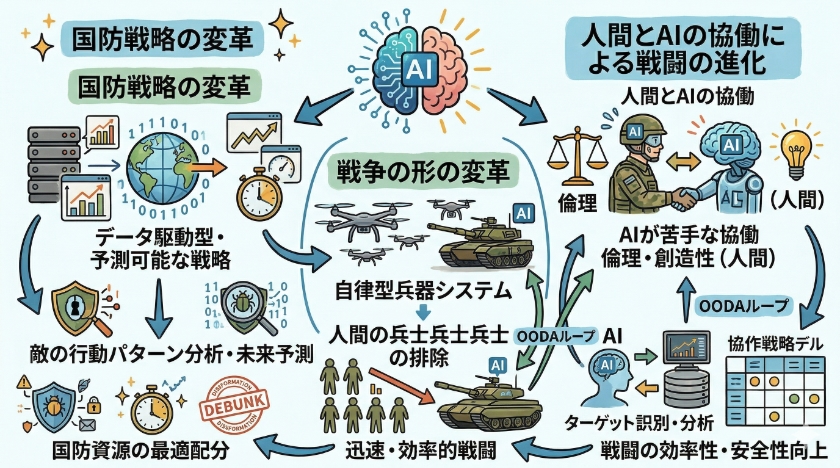

未来の戦場におけるAIの役割

国防戦略の変革

AIの軍事利用は、国防戦略に根本的な変革をもたらしています。

従来の軍事戦略は、人間の判断と経験に基づいていましたが、AIの活用により、よりデータ駆動型で予測可能な戦略が可能になります。

私は超DX仕事術の中で勘、経験、感情の3Kに頼らないことの重要性を説いていますが、これは国家の防衛戦略においても全く同じことが言えるのです 。

例えば、AIは、敵の行動パターンを分析し、未来の攻撃を予測することで、国防資源の最適な配分を支援します。

また、AIは、サイバー攻撃や偽情報の拡散など、新たな脅威に迅速に対応するための情報を提供します。

さらに、AIは、兵器システムの開発を加速させ、より高度な軍事能力を提供します。

しかし、AIに過度に依存することは、人間の判断能力を低下させ、戦略的な柔軟性を損なう危険性もあります。

ツールやAIはあくまで手段であり、思考停止に陥らずに自分の頭で考えるクリティカルシンキングの姿勢を忘れてはなりません 。

AIの活用がもたらす戦争の形

AIの軍事的な利用は、戦争の形を根本的に変える可能性があります。

AIを活用した自律型兵器システムは、人間の兵士を戦場から排除し、より迅速かつ効率的な攻撃を可能にします。

また、AIは、サイバー攻撃や情報操作など、従来の戦争の概念を覆す新たな戦場を創出します。

さらに、AIは、戦争の規模を拡大させ、国際的な紛争のリスクを高める可能性もあります。

例えば、AIが誤った判断を下した場合、戦争が制御不能な状況に陥る危険性があります。

これを防ぐためには、いきなりシステム化に飛びつくのではなく、V3Sの法則に基づいて現状を正しく可視化し、ボトルネックを特定するプロセスが欠かせません 。

これらのリスクを回避するためには、AIの軍事的な利用に関する厳格な倫理的ガイドラインと、国際的な規制が必要です。

人間とAIの協働による戦闘の進化

AIの軍事利用は、人間とAIの協働による戦闘の進化を加速させています。

AIは、情報収集・分析、標的の特定、兵器の制御など、人間が苦手とする分野で優れた能力を発揮し、人間の判断をサポートします。

これまで手作業で行っていたデータ収集や事務作業をRPAなどのシステムに任せることで、人間はより付加価値の高い業務に集中できるようになります 。

一方、人間は、倫理的な判断や創造的な問題解決など、AIが不得意とする分野でAIを補完します。

このような人間とAIの協働により、戦闘の効率性や安全性が向上し、より高度な軍事作戦が可能になります。

しかし、人間とAIの協働には、新たなリスクも伴います。

例えば、AIが誤った情報を提供した場合、人間が誤った判断を下す可能性があります。

これらのリスクを軽減するためには、AIシステムの透明性を高め、人間が常にAIの行動を監視し、必要に応じて介入できる仕組みを構築する必要があります。

超DX仕事術のレベル3で目指すデータ活用においても、システムが正しく機能しているかを人間が統制し、柔軟にOODAループを回し続けることが真のイノベーションを生み出す鍵となるのです 。

AIの軍事利用:戦争・戦場を変えるか?兵器開発の現状とリスクに関しての「よくある質問」

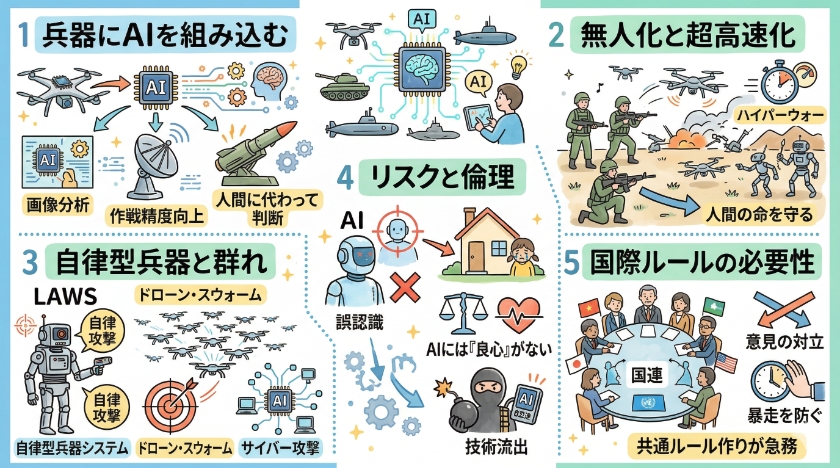

Q1: そもそも「AIの軍事利用」とはどういうことですか?

AIの軍事利用とは、人工知能(AI)の技術を兵器や作戦システムなどに組み込んで活用することを指します。

具体的には、レーダーの画像から敵の位置を瞬時に分析するシステムや、人間の操縦なしで自律的に飛行する無人ドローンなどが挙げられます。

これまで人間が頭を使って判断・操作していた部分をAIがサポート、あるいは代行することで、作戦のスピードを劇的に上げ、攻撃や防御の精度を高めることが主な目的とされています。

Q2: AIが導入されると、戦争や戦場はどのように変わるのでしょうか?

最も大きな変化は、「人間の兵士が直接戦う機会が減り、無人機やロボット同士の戦いが増える」という点です。AIを搭載した兵器が最前線に立つことで、兵士の命が失われるリスクは下がります。

しかし一方で、AIの情報処理や判断スピードは人間よりもはるかに速いため、戦争の展開が人間にはコントロールできないほど急激に加速する(ハイパーウォーと呼ばれる状態になる)危険性も指摘されています。

Q3: 現在、どのようなAI兵器が実際に開発されているのですか?

世界各国で開発が急がれている代表的なものに、自律型致死兵器システム(通称:LAWS)があります。これは、人間の指示や引き金を引く動作がなくても、AIが自ら標的を探し出し、攻撃の判断まで下してしまう兵器です。

また、数十〜数百機もの小型ドローンをAIで連携させて一斉に攻撃を行う「スウォーム(群れ)」技術や、敵のネットワークへのサイバー攻撃を自動で行うAIシステムなども実用化が進んでいます。

Q4: AI兵器にはどのようなリスクや倫理的な問題があるのでしょうか?

最大のリスクは、「AIが誤作動を起こしたり、誤った判断で民間人を巻き込んでしまう可能性」です。AIの画像認識などは完璧ではなく、想定外の状況では間違った判断を下すことがあります。

また、AIには人間のような「ためらい」や「良心」がないため、生命を奪うという重い決断を機械に任せてもよいのかという倫理的な問題が大きく問われています。

さらに、これらの高度な技術がテロリストなどに流出するリスクも軽視できません。

Q5: AIの軍事利用に対して、国際社会はどのように対応しているのですか?

現在、国連などを中心に、人間の関与がないままAIが攻撃を行う兵器(LAWSなど)を法的に規制しようという議論が活発に行われています。

しかし、AI技術による軍事的な優位性を手放したくない主要国と、完全な禁止を求める国やNGOとの間で意見が対立しており、国際的なルールの策定は難航しているのが実情です。

暴走を防ぐためには、世界共通の明確なルール作りが急務となっています。

DXやITの課題解決をサポートします! 以下の無料相談フォームから、疑問や課題をお聞かせください。40万点以上のITツールから、貴社にピッタリの解決策を見つけ出します。

このブログが少しでも御社の改善につながれば幸いです。

もしお役に立ちそうでしたら下のボタンをクリックしていただけると、 とても嬉しく今後の活力源となります。 今後とも応援よろしくお願いいたします!

IT・通信業ランキング | にほんブログ村 |

もしよろしければ、メルマガ登録していただければ幸いです。

【メルマガ登録特典】DX戦略で10年以上勝ち続ける実践バイブル『デジタル競争勝者の法則』をプレゼント!

今すぐプレゼントを受け取る

今すぐプレゼントを受け取る