「ChatGPT、このまま使い続けて本当に大丈夫なのだろうか…」─OpenAIの最近の動きを見て、そんな不安を抱え始めている方は多いのではないでしょうか。

連日のように報じられている、OpenAIによる「軍事利用に関する規約変更」。これまで明確に禁止されていたはずの条項がひっそりと書き換えられたことで国内外から大きな反発を招き、実際に解約や他社AIへの乗り換えを急ぐユーザーや企業が続出しています。

ビジネスに不可欠なツールとして定着しつつあるからこそ、今回の変更は単なるニュースにとどまりません。その背景にある「AI技術の軍事利用への根強い懸念」と、トップ企業であるはずの「OpenAIに対する信頼の揺らぎ」は、今後のAI活用における無視できないリスクになり得ます。

「自社のデータはどう扱われるのか?」「もしもの時の代替ツールの準備は必要なのか?」─状況が目まぐるしく変わる今、情報収集や方針転換に頭を悩ませている担当者の方も多いはずです。

この記事では、今回の規約変更がもたらすビジネスへの本当のインパクトから、企業やユーザーがリスクを回避するために「今すぐ検討すべき具体的なアクション」まで、詳しく解説していきます。

簡単に説明する動画を作成しました!

目次

背景:OpenAIと軍事利用を巡る議論

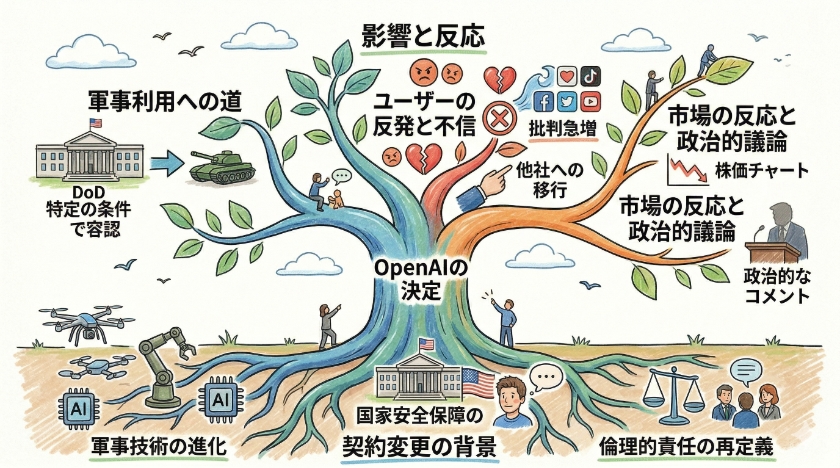

OpenAIは3月、軍事利用に関する契約内容を変更しました。

私もこれまで多くのITツールに触れてきましたが、どんなに優れたツールであっても常にセキュリティリスクが存在するということを念頭に置く必要があります。

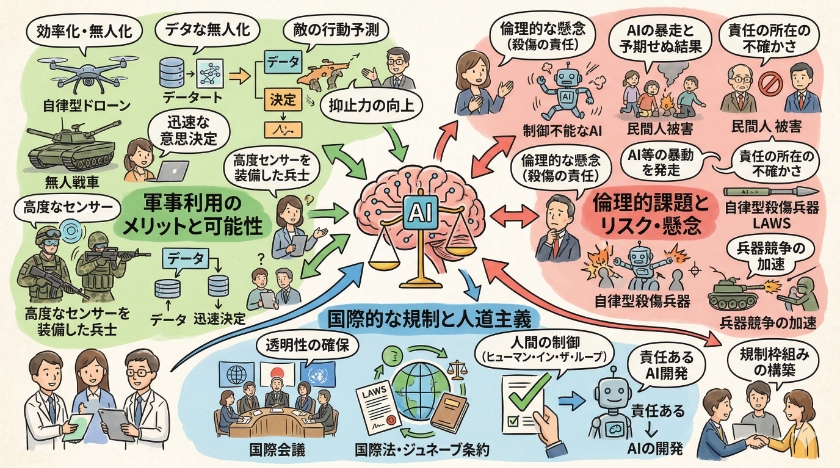

この変更は、同社の技術が軍事分野でどのように利用されるかについて、多くの懸念を引き起こしています。

特に、国防総省との契約締結の可能性や、自律型兵器へのAI技術の応用に対する批判が高まっています。

超DX仕事術を推進する上でも、利用するツールの背景やリスクをしっかりと理解しておくことは非常に重要です。

OpenAIのCEOであるサム・アルトマン氏は、AI技術の潜在的なリスクを認めつつも、国家安全保障の観点から、特定の条件下での軍事利用を認める考えを表明しています。

しかし、この説明は多くのユーザーや企業からの懸念を払拭するには至っていません。

反発の理由:倫理的懸念と情報の機密性

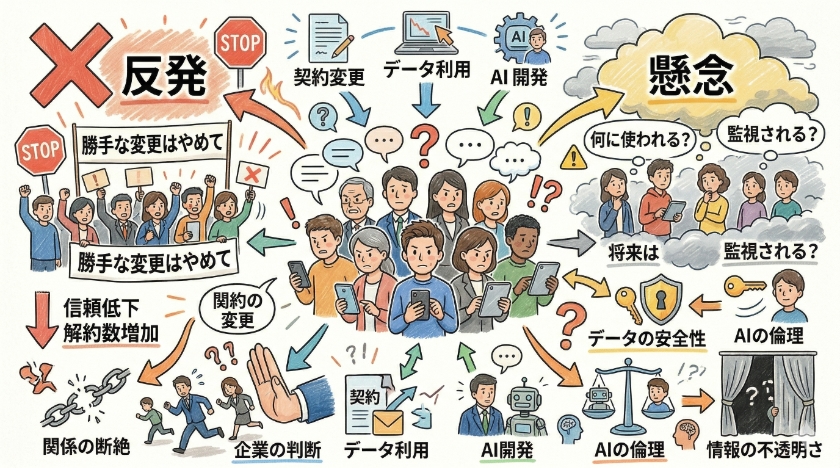

今回の契約変更に対する反発の主な理由は、AI技術の軍事利用に関する倫理的な懸念です。

私がITコンサルタントとして多くの企業を支援する中でも、情報の取り扱いについては常に厳重な注意喚起を行っています。

特に、ChatGPTのような対話型AIが、戦争や攻撃の目的で使用される可能性に対する懸念は深刻です。

また、OpenAIのシステムが、米国防総省や情報機関と連携することで、ユーザーの機密情報が漏洩するリスクも指摘されています。

機密情報が一度でも漏洩してしまえば、取り返しがつかない大問題に発展しかねません。

イランのような国がOpenAIの技術を悪用する可能性も考慮されなければならず、情報管理の徹底が求められています。

こうしたリスクに対処するためには、V3Sのフレームワークを用いてツール導入のボトルネックやリスクをしっかりと特定することが有効となります。

国内市場だけでなく、世界的な規模で、大規模な監視システムが構築されるのではないかという懸念も広がっています。

ChatGPT解約の動き:企業とユーザーの反応

OpenAIの軍事利用に関する姿勢の変化を受け、ChatGPTの解約を検討する企業やユーザーが増加しています。

企業DXであっても個人の仕事術であっても、システムがもたらす影響や責任を常に考えてツールを選定しなければなりません。

その理由としては、企業イメージの悪化リスクや、AI技術の倫理的な利用に対する企業の責任が挙げられます。

また、競合他社であるAnthropicのような、より倫理的なAI開発を目指す企業への乗り換えも検討されています。

今のツールに固執せず、状況に応じて別の使いやすい方法があるのではと疑うクリティカルシンキングがここでは活きてきます。

ソーシャルメディア上では、OpenAIに対する批判的な投稿が急増しており、国民の不信感が高まっていることが伺えます。

トランプ氏のような政治家も、この問題についてコメントを発表しており、政治的な議論も活発化しています。

変化の激しい予測困難な時代において、ITツールの選定は失敗を恐れずに臨機応変に対応し、常に最善の選択肢を探求し続けることが求められているのです。

契約変更の背景

国防総省との契約について

OpenAIが国防総省との契約締結の可能性を模索しているというニュースは、広範な反発を引き起こしました。

この契約により、OpenAIのAI技術が軍事利用される可能性が現実味を帯び、倫理的な懸念が急増しています。

私もITコンサルタントとして様々なツールを評価してきましたが、企業がどの技術をどう利用するかは、そのツールの信頼性に直結すると痛感しています。

特に、ChatGPTのようなチャットAIが、兵器システムに組み込まれ、戦争の遂行に使用されるのではないかという懸念は深刻です。

米国防総省との合意内容は、機密性が高く、完全に明確にされていないため、ユーザーや企業の不安を煽っています。

どんなに優れたITツールでも、背景にある意図やセキュリティリスクが見えないと、制御不能な状態に陥る危険性を孕んでいます。

OpenAIは、国家安全保障の観点から、同省との連携の必要性を表明していますが、国民の理解を得るには至っていません。

自律型AIの利用とその影響

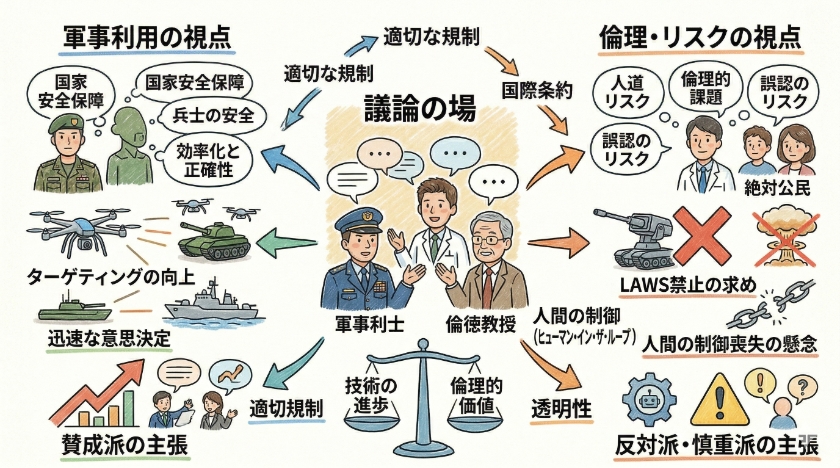

自律型AIの軍事利用は、特に懸念されています。

超DX仕事術でお伝えしているように、AIやシステムに処理を任せる自動化は非常に便利ですが、そこに人間の適切な判断が欠けると大きなリスクを伴います。

OpenAIの技術が自律型兵器に利用された場合、人間の判断を介さずに攻撃を実行する可能性があり、倫理的な問題が生じる可能性があります。

また、AIシステムが誤った判断を下した場合、大規模な被害を引き起こすリスクも存在します。

イランのような国がOpenAIの技術を悪用し、攻撃的な目的で使用する可能性も考慮する必要があります。

AIの導入は、軍事分野における意思決定の複雑化を招き、予期せぬ結果を招く可能性も否定できません。

こうした複雑な問題を整理するためには、V3Sのフレームワークのように現状を可視化し、細分化して特定するアプローチが欠かせません。

OpenAIは、AI技術の軍事利用に関する明確なガイドラインを示す必要がありそうです。

トランプ氏の意見と市場の反応

トランプ氏のような政治家も、OpenAIの軍事利用に関する問題についてコメントを発表し、市場の反応を注視しています。

OpenAIの株価や企業イメージに悪影響を及ぼす可能性もあり、経営陣は慎重な対応を迫られています。

これまで特定のツールに依存していた企業も、クリティカルシンキングを用いて、本当にこのまま使い続けてよいのかを疑う時期に来ているのかもしれません。

OpenAIの競合他社であるAnthropicは、より倫理的なAI開発を推進しており、OpenAIからAnthropicへ乗り換える企業も出てきています。

ソーシャルメディア上では、OpenAIに対する批判的な投稿が急増しており、国民の不信感が高まっていることが伺えます。

私が多くの企業を見てきた経験からも、一度失われた信頼を回復するには、ツール導入の際と同様に透明性のある情報共有を積み重ねるしかありません。

OpenAIは、3月に発表した契約変更について、詳細な説明を行い、ユーザーの懸念を払拭する必要があります。

OpenAIは、アメリカの会社であり、アメリカ市場だけでなく、世界市場への影響も考慮する必要があるでしょう。

ユーザーの反発と懸念

ChatGPT解約の動き

OpenAIの軍事利用に関する契約変更発表を受け、ChatGPTの解約の動きが急増しています。

企業は、自社のブランドイメージを守るため、また、AI技術の倫理的な利用に対する姿勢を示すため、OpenAIとの契約を見直す動きを加速させています。

私もこれまで数多くのITツール導入を支援してきましたが、企業のブランドイメージや信頼性に直結するツールの選定には、経営層が非常に敏感になるのも当然のことと言えます。

ユーザーの中には、OpenAIの技術が軍事兵器開発に利用されることに強い反発を感じ、他のチャットAIシステムへの移行を検討する人もいます。

このような解約の動きは、ソーシャルメディア上での批判的な投稿の急増にも表れており、国民のOpenAIに対する信頼が揺らいでいることを示しています。

OpenAIは、この状況を重く受け止め、早急な対応を迫られています。

批判の声とその内容

OpenAIに対する批判の声は、多岐にわたります。

その主な内容は、AI技術の軍事利用に対する倫理的な懸念、ユーザーの機密情報が米国防総省や情報機関に漏洩するリスク、そして、イランのような国がOpenAIの技術を悪用する可能性に対する懸念です。

ITツールの利便性とは裏腹に、機密情報が一度でも漏洩してしまえば、取り返しがつかなくなることもあります。

また、大規模な監視システムが構築されるのではないかという懸念も根強く、OpenAIの説明責任を求める声が高まっています。

サム・アルトマンCEOの説明は、これらの批判を払拭するには至っておらず、契約内容の更なる明確化と、倫理的なガイドラインの策定が求められています。

どんなに優れたITツールでも、背景にある意図や運用したときの透明性に問題ないかを気をつけて選定しなければなりません。

軍事利用に対する一般の意見

AI技術の軍事利用に対する一般の意見は、概ね否定的なものです。

多くの国民は、AIが自律型兵器に利用され、人間の判断を介さずに攻撃が実行されることを強く懸念しています。

超DX仕事術でお伝えしているように、システムに任せる自動化は非常に便利ですが、そこに人間の適切な判断が欠けると、思わぬ被害を引き起こすリスクが存在します。

また、AIが戦争の遂行に使用されることで、人道的な危機が深刻化する可能性も指摘されています。

トランプ氏のような政治家もこの問題についてコメントを発表しており、国民の関心を集めています。

OpenAIは、このような国民の意見を真摯に受け止め、AI技術の軍事利用に関する方針を再検討する必要があります。

国内市場だけでなく、世界市場への影響も考慮し、倫理的な原則を遵守したAI開発を進めることが求められます。

AI技術の軍事利用に関する議論

イランとの関係と影響

OpenAIのAI技術が、OpenAIのAI技術が軍事利用されることに対する懸念は、イランのような国との関係においても深刻な影響を及ぼす可能性があります。

私もこれまで数多くのシステム導入に携わってきましたが、ITツールの利便性の裏には常に悪用されるリスクが潜んでいることを忘れてはなりません。

イランがOpenAIの技術を悪用し、攻撃的な目的で使用するリスクは、米国だけでなく国際社会全体にとって大きな脅威となります。

特に、ChatGPTのようなチャットAIが、プロパガンダの拡散やサイバー攻撃の実行に利用される可能性は否定できません。

OpenAIは、自社の技術がテロ組織や敵対勢力によって悪用されないよう、厳格な監視システムを構築し、イランを含む特定の国々への技術供与を厳しく制限する必要があります。

これは企業におけるシャドーIT問題にも似ており、管理者の目の届かないところで野良ツールとして悪用されれば、取り返しがつかない事態に発展してしまいます。

アメリカ合衆国は、同社の技術の安全保障上のリスクを評価し、必要な規制を導入することが求められます。

このような措置を通じて、OpenAIは国際社会における責任を果たすとともに、自社の技術が平和的な目的にのみ使用されるよう努めるべきです。

米国におけるAIの市場動向

米国市場におけるAIの市場動向は、OpenAIの軍事利用に関する契約変更の影響を大きく受けています。

企業やユーザーは、OpenAIの倫理的な姿勢に対する懸念から、競合他社であるAnthropicのような、より倫理的なAI開発を目指す企業への乗り換えを検討しています。

超DX仕事術でも触れていますが、一つのツールに依存するのではなく、状況に応じて最適なシステムを選定する柔軟性が、これからの時代には不可欠です。

トランプ氏のような政治家の意見も、市場の反応に影響を与えており、OpenAIの経営陣は慎重な対応を迫られています。

OpenAIの契約変更発表後、同社の株価や企業イメージに悪影響が出ている可能性もあり、国内市場での競争力低下が懸念されます。

アメリカの企業として、OpenAIは国内の倫理基準を遵守し、国民の信頼を回復するための努力が必要です。

また、米国防総省との契約締結については、国民の理解を得られるよう、透明性の高い説明を行う必要があります。

今後の展望と懸念の表明

今後の展望としては、OpenAIがAI技術の軍事利用に関する明確なガイドラインを策定し、倫理的な原則を遵守した開発を進めることが不可欠です。

自律型兵器への利用や、ユーザーの機密情報が漏洩するリスクに対する懸念を払拭するため、契約内容の更なる明確化と、セキュリティ対策の強化が求められます。

こうした課題をクリアにするためには、V3Sのフレームワークを用いて現状を可視化し、リスクとなるボトルネックを特定して改善していくアプローチが非常に有効です。

また、OpenAIは、ソーシャルメディア上での批判的な投稿や、ChatGPT解約の動きを真摯に受け止め、国民との対話を深める必要があります。

OpenAIのCEOであるサム・アルトマン氏は、AI技術の潜在的なリスクを認めつつも、国家安全保障の観点から、特定の条件下での軍事利用を認める考えを表明していますが、その具体的な内容については、更なる説明が求められます。

どんなに便利なツールであっても、利用する側のセキュリティリテラシーを高め、適切な対策を講じなければ本当の意味での課題解決には至りません。

OpenAIがこれらの課題に適切に対応することで、AI技術の健全な発展と、社会への貢献が期待されます。

OpenAI、軍事利用の契約変更で反発急増?ChatGPT解約に関しての「よくある質問」

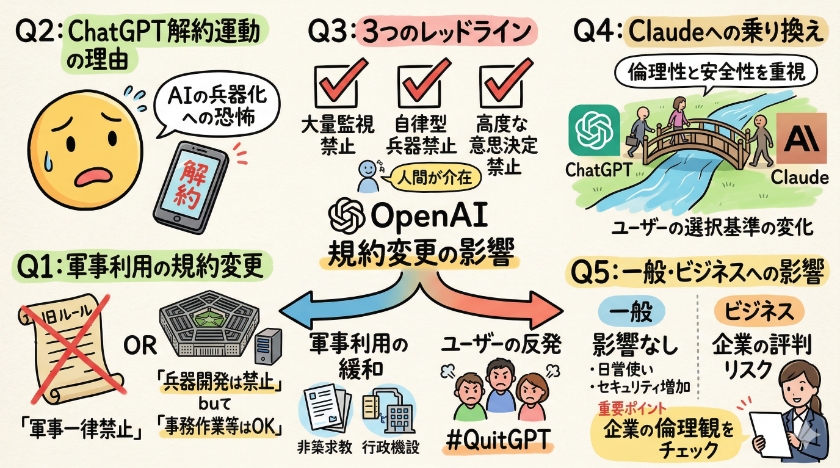

Q1: OpenAIが軍事利用に関する規約を変更したのは本当ですか?

はい、本当です。OpenAIは以前、利用規約の中で「軍事および戦争(Military and warfare)」への利用を一律に禁止していましたが、2024年初頭にこの文言を削除しました。

これまでは「兵器開発」だけでなく「軍事目的すべて」がNGとされていましたが、現在は「兵器の開発」や「他人を傷つける行為」は禁止しつつも、国防省(ペンタゴン)などが事務作業やサイバーセキュリティ、インフラ維持などの「国民を守るための業務」にAIを活用することを認める形になっています。

Q2: なぜ「ChatGPT解約運動」が起きているのですか?

主な理由は、AIが「人を傷つけるための道具」に変質してしまうことへの恐怖心です。

特にSNS上では、国防総省との契約が「大量監視」や「自律型兵器」につながるのではないかという懸念が広がりました。

また、競合のAnthropic(アンソロピック)社が「監視活動への利用」を拒否して政府と対立したのに対し、OpenAIが政府と巨額の契約を結んだことを「利益優先の裏切り」と捉えるユーザーが多く、ハッシュタグ「#QuitGPT」などを通じた解約運動に発展しました。

Q3: OpenAIは軍事利用に対してどのような制限(レッドライン)を設けていますか?

批判を受けて、OpenAIのサム・アルトマンCEOは、軍事利用においても「超えてはいけない3つのレッドライン」を明確に示しました。

- 国内の大量監視活動に利用させないこと

- 人間が介在しない自律型兵器の開発に利用させないこと

- 人生を左右するような高度な自動意思決定(裁判の判決など)に利用させないこと

これらは技術的なセーフガードとしてモデルに組み込まれており、「AIが勝手に攻撃の判断を下す」ような事態は防ぐとしています。

Q4: ユーザーがChatGPTから「Claude」へ乗り換えているのはなぜですか?

OpenAIの姿勢に反発したユーザーが、より倫理性や安全性を重視しているイメージのあるAnthropic社のAI「Claude(クロード)」に流れているからです。

実際に、米国のApp StoreでClaudeがダウンロード数1位を記録するなどの現象が起きました。

DXの視点で見ると、ユーザーは単なる「便利さ」だけでなく、「その企業が社会に対してどのような倫理観を持っているか」をサービス選択の基準にするようになっています。

Q5: この問題は、一般の個人ユーザーやビジネス利用に影響しますか?

今のところ、私たちが普段使っているChatGPTの機能や安全性に直接的な悪影響はありません。 むしろ、政府機関との連携を通じて、サイバー攻撃を防ぐ能力などが向上する側面もあります。

しかし、DXを進める企業にとっては、「自社が使っているAIツールが社会的にどう評価されているか」というレピュテーションリスク(評判への影響)を無視できなくなっています。

AI選びにおいては、機能だけでなく企業の公開しているポリシーを定期的にチェックすることが、これからのビジネスパーソンの必須スキルと言えます。

DXやITの課題解決をサポートします! 以下の無料相談フォームから、疑問や課題をお聞かせください。40万点以上のITツールから、貴社にピッタリの解決策を見つけ出します。

このブログが少しでも御社の改善につながれば幸いです。

もしお役に立ちそうでしたら下のボタンをクリックしていただけると、 とても嬉しく今後の活力源となります。 今後とも応援よろしくお願いいたします!

IT・通信業ランキング | にほんブログ村 |

もしよろしければ、メルマガ登録していただければ幸いです。

【メルマガ登録特典】DX戦略で10年以上勝ち続ける実践バイブル『デジタル競争勝者の法則』をプレゼント!

今すぐプレゼントを受け取る

今すぐプレゼントを受け取る