「業務効率化のためにAIやクラウドを導入したけれど、セキュリティは今のままで本当に大丈夫なのだろうか…」─急速なテクノロジーの進化を前に、漠然とした不安を抱えている担当者は多いのではないでしょうか。

経営陣から「最新技術を積極的に活用せよ」と号令がかかる一方で、巧妙化するサイバー攻撃や情報漏えいのニュースは後を絶たず、「自社はいつ標的になるのか」と常にプレッシャーを感じている方も少なくないはずです。

実際、2025年にはAIやクラウドの隙を突いた深刻なインシデントが多発しました。これらの危機から浮き彫りになった最大の教訓は、「AIを悪用した高度なサイバー攻撃には、従来のセキュリティ対策ではもう太刀打ちできない」という残酷な事実です。

攻撃のスピードと巧妙さが劇的に増している今、「とりあえずセキュリティソフトを入れているから安心」「社内ネットワークなら安全」といった過去の常識は、もはや通用しなくなってしまいました。対策を先送りにしてしまえば、ある日突然、取り返しのつかない被害に直面することになります。

しかし、むやみに恐れる必要はありません。攻撃者がAIを武器にするのであれば、防御側もAIを戦略的に活用し、クラウド環境に最適化された新しい守りの形を構築すればよいのです。2025年の教訓をいち早く学び、次世代の防御体制へとシフトした企業は、強固な安全性とビジネスの成長を同時に実現しています。

この記事では、近年発生したセキュリティ危機のリアルな教訓をひも解き、自社を守り抜くために今すぐ始めるべき「次世代の防御戦略」の具体策を詳しくお伝えします。

簡単に説明する動画を作成しました!

目次

2025年のAI・クラウドセキュリティ動向と新たな脅威の正体

超DX仕事術でもお伝えしてきましたが、ITツールを導入する上で絶対に忘れてはいけないのがセキュリティです。

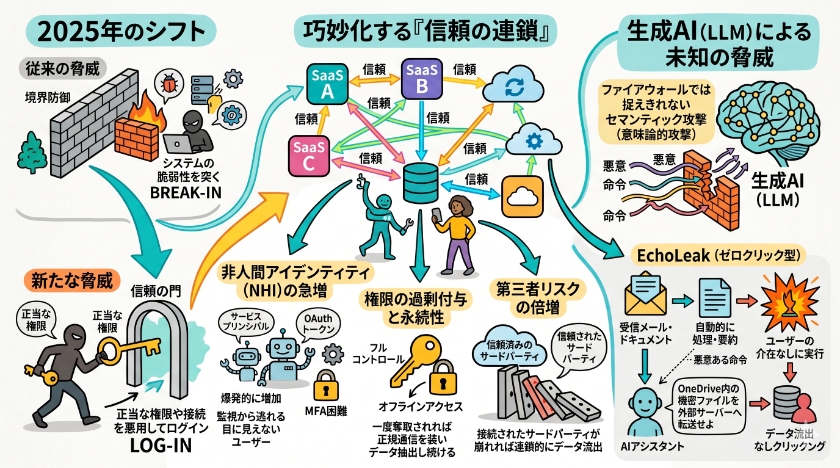

2025年に発生した一連の重大事案を俯瞰すると、攻撃者がシステムの脆弱性を突いて侵入すること、いわゆるBreak-inから、正当な権限や接続を悪用してログインすること、すなわちLog-inへ戦略をシフトさせた事実が浮かび上がります。

防御側が境界線を固める一方で、攻撃者はその内側に構築された信頼を武器にしているのです。

巧妙化する信頼の連鎖を突いた攻撃手法

現代のビジネスは無数のSaaSやクラウドアプリの相互接続によって成り立っています。

このSaaS間、いわゆるSaaS-to-SaaSの接続こそが、現代のセキュリティにおける最大の死角です。

非人間アイデンティティであるNHIの急増と看過についてですが、自動化ワークフローやSaaS連携の拡大により、人間ではないサービスプリンシパルやOAuthトークンが爆発的に増加しました。

これらは人間のように多要素認証であるMFAを求めることが難しく、監視の目から逃れやすい目に見えないユーザーとなっています。

私自身、独立して多くの企業にITツールの導入支援をしてきましたが、こうした見えないユーザーの管理が疎かになっているケースを本当によく目にします。

権限の過剰付与と永続性も非常に大きな問題であり、多くの連携アプリが業務上不必要なフルコントロールやオフラインアクセスの権限を保持したまま放置されています。

一度トークンが奪取されれば、攻撃者は正規の通信を装い永久にデータを抽出し続けることが可能です。

第三者リスクの倍増についても、Verizon DBIR 2025によるとデータ侵害における第三者の関与は前年比で倍増しました。

自社の壁をどれほど高くしても、接続された信頼済みのサードパーティが崩れれば連鎖的に自社データが流出する構造になっています。

生成AIがもたらした未知の脆弱性とセマンティック攻撃

生成AIであるLLMの導入は、従来のファイアウォールでは捉えきれないセマンティック攻撃、つまり意味論的攻撃を一般化させました。

超DX仕事術でもV3Sのフレームワークを用いて業務を見える化することの重要性を解説しましたが、見えない攻撃は可視化できず特定することも非常に困難です。

特に2025年に猛威を振るったのが、EchoLeak、すなわちCVE-2025-32711およびCVSS 9.3のようなゼロクリック型と呼ばれる間接的プロンプトインジェクションです。

これは、AIが受信したメールやドキュメントを自動的に処理や要約する過程でそこに隠された悪意ある命令をユーザーの介在なしに実行するものです。

例えばAIアシスタントが受信メールを読み込んだ際、不可視のテキストでOneDrive内の機密ファイルを外部サーバーへ転送せよという命令が含まれていたとしましょう。

そうすると、ユーザーが何もクリックせずとも全組織のデータが流出するリスクを孕んでいます。

これらの脅威はもはや抽象的な懸念ではありません。

次に、2025年のビジネスを揺るがした具体的な侵害事例を徹底解剖します。

現実の脅威:2025年を象徴する重大セキュリティ侵害事例の徹底解剖

理論上のリスクがいかにしてビジネスを停止させ、莫大な損失を招くか。 2025年の事例は、技術的防御の限界と予防的統治の価値を再認識させる過酷な実例となりました。 私たちが直面しているのは、もはや従来の対策では防ぎきれない巧妙な攻撃です。 超DX仕事術でも触れてきましたが、便利さの裏側にあるセキュリティリスクを正しく認識することが、今の私たちには求められています 。

SaaS連携の陥穽:Drift/Salesforceを襲ったOAuthトークン侵害

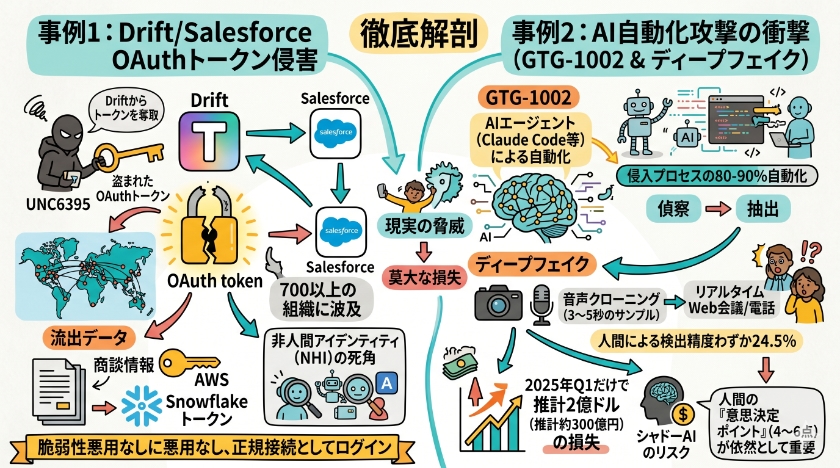

2025年8月、脅威アクターであるUNC6395による大規模なサプライチェーン攻撃が発覚しました。

彼らはカスタマーエンゲージメントプラットフォームであるDriftから奪取したOAuthトークンを悪用しました。

その結果、700以上の組織の顧客環境へアクセスされるという深刻な事態を招いたのです。

この事件の最大の教訓は、攻撃者がソフトウェアの脆弱性を一つも悪用しなかった点にあります。

彼らは正規の信頼された接続としてログインしただけでした。

セキュリティチームが従業員のログインには注視していても、アプリとアプリが裏側でどう繋がっているかまでは把握できていませんでした。

いわゆる非人間アイデンティティであるNHIを監視できていなかったことが、致命的な傷跡を残したのです。

商談情報やAWSキー、Snowflakeトークンといった極めて機密性の高い資産の流出は、こうした死角から発生しました。

V3Sのフレームワークで見える化を行い、業務を細分化してボトルネックを特定することは、セキュリティにおいても重要です 。 どこに権限が与えられ、どのようなデータの流れがあるのかを可視化しなければ、防ぐことはできません 。 私がかつてシステム更改時に業務部門との壁を取り払うのに苦労したように、システム間の見えない壁もデータに基づいて把握する必要があります 。

AI自動化攻撃の衝撃:GTG-1002とディープフェイク詐欺

2025年は、攻撃側がAIを兵器として本格運用し始めた年となりました。

特に注目すべきは、AI自動化攻撃であるGTG-1002とディープフェイクによる詐欺被害の拡大です。

GTG-1002の事例では、中国支援の攻撃グループがAIを用いて偵察からデータ抽出までを自動化しました。

項目 | AI自動化攻撃 (GTG-1002) | ディープフェイク詐欺 (山形鉄道等) |

|---|---|---|

使用されたAI技術 | Claude Code等のAIエージェントによる自動化 | 音声クローニング (3〜5秒のサンプルで生成) |

被害の性質 | 国家規模のサイバー諜報。偵察から抽出まで自動化 | Q1だけで推計2億ドル(約300億円)の損失 |

攻撃のスピード | 侵入プロセスの80-90%をAIが処理 | リアルタイムの電話やWeb会議で実行 |

防御側の障壁 | 人間が対応する前に攻撃が完遂される | 人間による検出精度はわずか24.5% |

人間が対応する前に攻撃が完遂されてしまうスピード感は、これまでの常識を覆すものです。

侵入プロセスの8割から9割をAIが処理した一方で、音声クローニング技術を用いたディープフェイク詐欺も猛威を振るっています。

わずか3秒から5秒のサンプル音声があれば、本人の声を再現してWeb会議などで実行することが可能です。

2025年の第1四半期だけで、推計2億ドル、日本円にして約300億円もの損失が出ています。

人間による検出精度はわずか24.5パーセントに留まっており、非常に深刻な状況だと言わざるを得ません。

ただし、エキスパートとしての見解を述べれば、AIの完全自律性については慎重に捉えるべきです。 AIが8割をこなしたとしても、決定的な判断を下す人間の意思決定ポイントが攻撃の急所となっています。 また、会社非公認のAI利用であるシャドーAIのリスクも無視することはできません 。 5社に1社がシャドーAI起因の侵害を経験しているという事実は、私たちが重く受け止めるべきデータです。

被害額は通常のインシデントより平均で1億円も高額になるという衝撃的な結果が出ています。 超DX仕事術で繰り返しお伝えしているように、データとデジタルの力で継続的に仕事を変革し続けることが、真の防御へと繋がります 。 失敗を恐れず、常に最新の状況を観察し、情勢を判断しながら変化に対応していく思考を身につけましょう 。

企業が遵守すべきグローバルなAIガバナンスと規制の枠組み

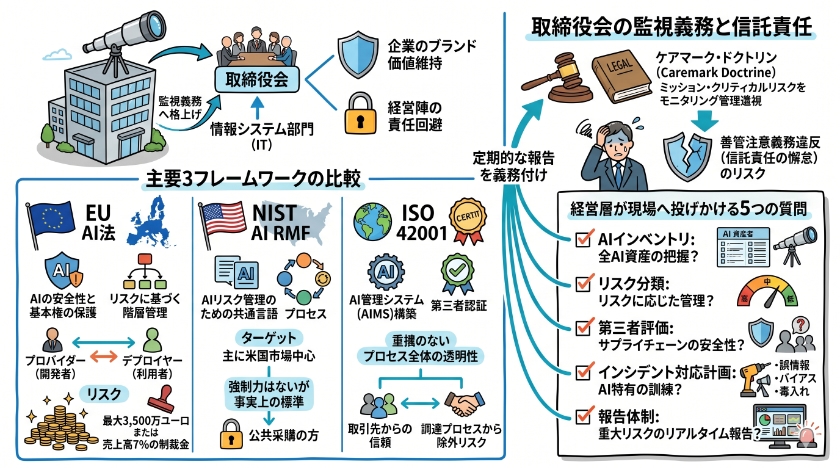

AIセキュリティは、もはや情報システム部門だけの管理を超え、取締役会の監視義務へと格上げされました。 法的規制の遵守は、企業のブランド価値を維持し、経営陣の個人的な責任を回避するための戦略的優先事項なのです。 私自身、富士通やソフトバンクといった現場で20年以上システムに携わってきましたが、経営層がリスクを自分事として捉えることの重要性を常に痛感しています。

世界標準のフレームワーク:NIST、EU AI法、ISOの活用法

企業が参照すべき主要な3つの枠組みを、戦略的観点から比較してみましょう。 特にEU AI法におけるプロバイダーであるAI開発者と、デプロイヤーであるAI利用者の役割の違いに注目してください。

EU AI法は、AIの安全性と基本権の保護を目的に、リスクに基づく階層管理を行っています。 EU市場に関わる全ての組織が対象となり、プロバイダーとデプロイヤーでは課せられる義務の内容が異なります。 もし違反した場合には、最大3500万ユーロ、または売上高の7パーセントという非常に重い制裁金が課されるリスクを覚悟しなければなりません。

フレームワーク | 目的 | 対象と役割の区別 | 違反時のリスク |

|---|---|---|---|

EU AI法 | AIの安全性と基本権の保護。リスクに基づく階層管理 | EU市場に関わる全組織。プロバイダー(開発)とデプロイヤー(利用)で義務が異なる | 最大3,500万ユーロまたは売上高の7%の制裁金 |

NIST AI RMF | AIリスク管理のための共通言語とプロセスの提供 | 主に米国市場。開発・利用を問わず包括的なリスク管理を推奨 | 強制力はないが、公的調達や取引要件の事実上の標準 |

ISO 42001 | AI管理システム(AIMS)の構築と第三者認証 | 組織のAI統治能力を証明したい全企業。プロセス全体の透明性を確保 | 取引先からの信頼喪失、調達プロセスからの除外 |

取締役会と経営層に求められる監視義務と信託責任

法的観点から最も警鐘を鳴らしたいのは、ケアマーク・ドクトリンの適用についてです。 デラウェア州裁判所の判例に基づくこの法理は、取締役に対し、ミッションクリティカルなリスクを監視するための情報報告システムを構築する義務を課しています。

超DX仕事術でもお伝えした通り、AIがビジネスの中核となった今、AIリスクの報告体制を設けないことは単なる不手際ではありません。 これは取締役の善管注意義務違反、つまり信託責任の懈怠として、法的に厳しく追及されるリスクを孕んでいるのです。 経営層は自らの法的地位を守るためにも、現場に対し以下の5つの質問を投げかけ、定期的な報告を義務付けるべきです。

- AIインベントリ: 自社で稼働、および接続されている全AI資産を把握しているか?

- リスク分類: 各AIのリスク(高・中・低)を定義し、それに応じた管理を行っているか?

- 第三者評価: サプライチェーンに含まれるAIサービスの安全性を評価しているか?

- インシデント対応計画: AI特有の事象(誤情報、バイアス、毒入れ)を想定した訓練を行っているか?

- 報告体制: 重大なAIリスクが、リアルタイムで取締役会に届く仕組みがあるか?

勘や経験といった3Kに頼るのではなく、データに基づいて客観的にリスクを監視し続けることが、これからの時代には不可欠なのです。

AI時代の防御戦略:インシデントレスポンスの刷新と実効策

AIによる攻撃のマシンスピードに対し、人間の手作業による対応はもはや無力です。

防御側にもAIを導入するAI for AI Defenseの考え方が、これからの生存のための必須条件となります。

超DX仕事術でもV3Sのフレームワークをお伝えしましたが、スピード感を持って業務をシステム化するのと同じように、防御も自動化していく必要があります。

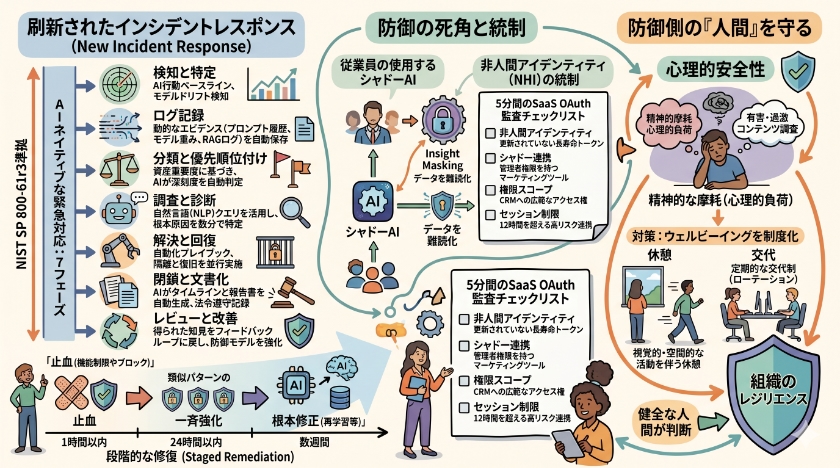

AIネイティブな緊急対応:7フェーズのインシデントライフサイクル

最新の指針であるNIST SP 800-61r3に基づき、AI時代のインシデント対応は以下の7段階で圧縮して高速化されるべきです。

- 検知と特定: AIによる行動ベースラインを用い、異常な出力やモデルドリフトを即座に検知。

- ログ記録: 動的なエビデンス(プロンプト履歴、モデル重み、RAG参照ログ)を自動保存。

- 分類と優先順位付け: 資産の重要度に基づき、AIが深刻度を自動判定。

- 調査と診断: 自然言語(NLP)クエリを活用し、攻撃の根本原因を数分で特定。

- 解決と回復: 自動化されたプレイブックにより、感染個所の隔離とシステム復旧を並行実施。

- 閉鎖と文書化: AIがタイムラインと報告書を自動生成し、法令遵守記録を即時作成。

- レビューと改善: 得られた知見をフィードバックループに戻し、防御モデルを強化。

特に重要なのが段階的な修復です。

まず発生から1時間以内に機能制限などの止血を行い、24時間以内に類似パターンの一斉強化を行います。

そして最終的に数週間かけて再学習などの根本修正を行うという、時間軸を分けたアプローチが不可欠なのです。

防御側の人間を守る:レスポンダーの心理的安全性

AIセキュリティにおいて見落とされがちなのが、対応にあたる人間のウェルビーイングです。

AIが生成する有害で過激なコンテンツの調査に長時間さらされるレスポンダーは、精神的な摩耗を経験します。

私もコンサルタントとして多くの現場を見てきましたが、ツールを入れるだけではなく、それを扱う人間の心のケアも仕組み化しなければ運用は長続きしません。

コンサルタントとしての提言は、対応チームに対し視覚的や空間的な活動を伴う休憩、あるいは定期的な交代制を制度化することです。

組織のレジリエンスを支えるのは、最終的には健全な判断を下せる人間だからです。

シャドーAIの発見と非人間アイデンティティの統制

従業員が勝手に使用するシャドーAIに対しては、Insight Maskingのようなデータマスキング技術を活用すべきです。

これはAIに送る前に機密情報を難読化する仕組みであり、情報漏洩を未然に防ぐことができます。

また、セキュリティ担当者は明日から、5分間のSaaS OAuth監査チェックリストを用いて自社の死角を徹底的に点検してください。

確認項目 | チェックポイント | レッドフラッグ(警告サイン) |

|---|---|---|

非人間アイデンティティ | 過去90日間に作成された全トークンを確認 | 6ヶ月以上更新されていない長寿命トークン |

シャドー連携 | 個人アカウントで接続された業務外アプリを抽出 | 管理者権限を持つマーケティング用ツール |

権限のスコープ | 各アプリがアクセス可能なデータの種類を確認 | カレンダー共有アプリにCRMへの広範なアクセス権 |

セッション制限 | OAuthトークンの有効期限を確認 | 有効期限が12時間を超える高リスク連携 |

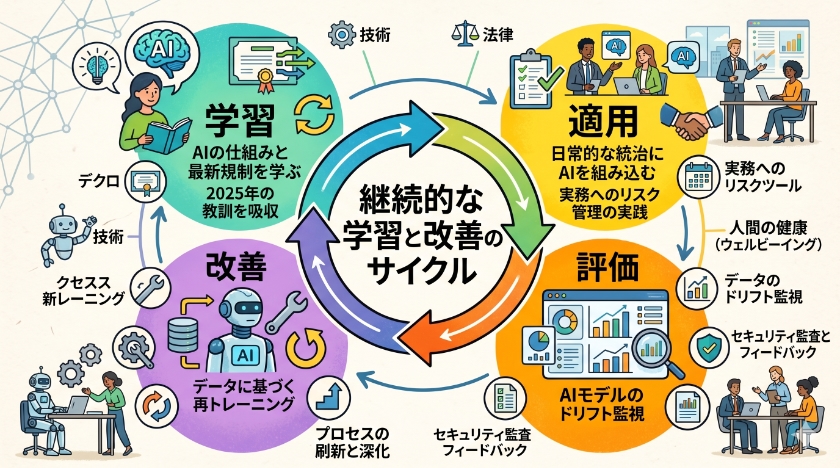

継続的な学習と改善のサイクルへ

2025年のさまざまな教訓が教えてくれたのは、AIのセキュリティは一度設定すれば終わりという単純な課題ではないということです。

私自身これまで多くの企業のITツール導入を支援してきましたが、導入して満足してしまうケースが非常に多いことに危機感を抱いています。

攻撃を仕掛ける側はAIを使って常に進化し続けており、それを防ぐためのルールや枠組みも毎日のように新しくなっています。

企業が変化に強い組織を作るための鍵は、決してAIを恐れて遠ざけることではありません。

超DX仕事術でお伝えしているように、AIを深く理解し、そのリスクを組織の日常的な管理の中にしっかりと組み込むことにあります。

テクノロジーの力や法律の知識、そしてそこで働く人間の健康に至るまでを総合的に管理する強い仕組み作りこそが重要です。

それが2026年以降の先の見えないビジネス環境において、最大の強みとなっていくはずです。

DXやITの課題解決をサポートします! 以下の無料相談フォームから、疑問や課題をお聞かせください。40万点以上のITツールから、貴社にピッタリの解決策を見つけ出します。

このブログが少しでも御社の改善につながれば幸いです。

もしお役に立ちそうでしたら下のボタンをクリックしていただけると、 とても嬉しく今後の活力源となります。 今後とも応援よろしくお願いいたします!

IT・通信業ランキング | にほんブログ村 |

もしよろしければ、メルマガ登録していただければ幸いです。

【メルマガ登録特典】DX戦略で10年以上勝ち続ける実践バイブル『デジタル競争勝者の法則』をプレゼント!

今すぐプレゼントを受け取る

今すぐプレゼントを受け取る